Pergantian tongkat model AI sumber terbuka telah terjadi antara beberapa perusahaan selama bertahun-tahun sejak debut ChatGPT pada akhir 2022. Dari Meta dengan keluarga Llama-nya hingga laboratorium Tiongkok seperti Qwen dan z.ai. Namun belakangan ini, perusahaan-perusahaan Tiongkok mulai beralih kembali ke model proprietary, sementara beberapa laboratorium AS seperti Cursor dan Nvidia merilis varian mereka sendiri dari model-model Tiongkok tersebut. Hal ini menimbulkan tanda tanya mengenai siapa yang akan menjadi pelopor teknologi ini ke depannya.

- Asal Usul Laboratorium Frontier dengan 30 Orang

- Rekayasa Melalui Batasan Arsitektur yang Ekstrem

- Kurikulum Data dan Penalaran Sintetik

- Peralihan dari Chatbot yang Bising ke Agen Penalaran

- Geopolitik dan Kasus untuk Bobot Terbuka Amerika

- Performa Benchmark dan Bagaimana Trinity-Large-Thinking Menyatukan Direktorat AI Sumber Terbuka AS Lainnya

- Kepemilikan sebagai Fitur untuk Industri yang Diatur

- Verdict Komunitas dan Masa Depan Distilasi

Salah satu jawabannya adalah Arcee, sebuah laboratorium yang berbasis di San Francisco, yang minggu ini meluncurkan AI Trinity-Large-Thinking—sebuah model penalaran berbasis teks dengan 399 miliar parameter, yang dirilis di bawah lisensi Apache 2.0 yang sangat terbuka. Ini memungkinkan kustomisasi penuh dan penggunaan komersial oleh siapa saja, mulai dari pengembang indie hingga perusahaan besar.

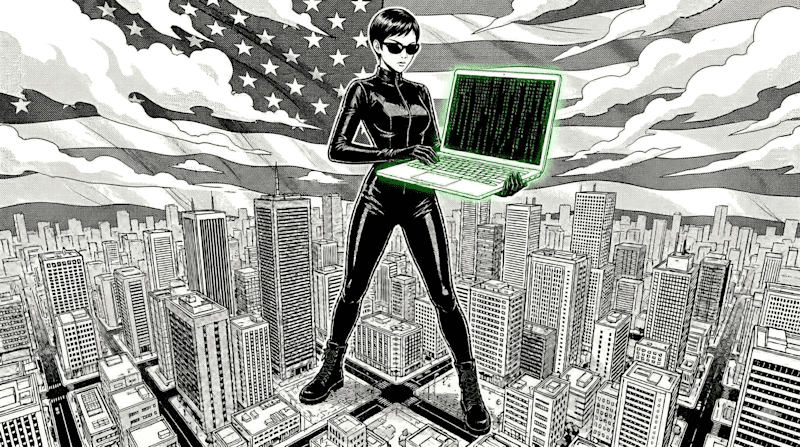

Pelepasan ini lebih dari sekedar set bobot baru di komunitas berbagi kode AI Hugging Face. Ini adalah taruhan strategis bahwa “Bobot Terbuka Amerika” dapat memberikan alternatif yang berdaulat terhadap model-model frontier yang semakin tertutup atau terbatas pada tahun 2025.

Langkah ini datang pada saat perusahaan semakin khawatir untuk bergantung pada arsitektur berbasis Tiongkok untuk infrastruktur kritis, menciptakan permintaan akan juara domestik yang ingin dipenuhi oleh Arcee.

Seperti yang disampaikan Clément Delangue, co-founder dan CEO Hugging Face, kepada VentureBeat melalui pesan langsung di X: “Kekuatan AS selalu terletak pada startupnya, jadi mungkin mereka yang seharusnya kita harapkan untuk memimpin dalam AI sumber terbuka. Arcee menunjukkan bahwa ini mungkin!”

Asal Usul Laboratorium Frontier dengan 30 Orang

Untuk memahami bobot dari peluncuran Trinity, kita harus memahami laboratorium yang membangunnya. Berbasis di San Francisco, Arcee AI adalah tim ramping dengan hanya 30 orang.

Di saat para pesaing seperti OpenAI dan Google beroperasi dengan ribuan insinyur dan anggaran komputasi miliaran dolar, Arcee mendefinisikan dirinya melalui apa yang disebut CTO Lucas Atkins sebagai “rekayasa melalui batasan”.

Perusahaan ini pertama kali menarik perhatian pada tahun 2024 setelah mendapatkan pendanaan Seri A sebesar $24 juta yang dipimpin oleh Emergence Capital, membawa total modalnya mendekati $50 juta. Awal tahun 2026, tim ini mengambil risiko besar: mereka mengalokasikan $20 juta—hampir separuh total pendanaan mereka—untuk satu kali pelatihan Trinity Large yang berlangsung selama 33 hari.

Menggunakan klaster 2048 NVIDIA B300 Blackwell GPU yang menawarkan kecepatan dua kali lipat dari generasi Hopper sebelumnya, Arcee mempertaruhkan masa depannya dengan keyakinan bahwa para pengembang membutuhkan model frontier yang benar-benar dapat mereka miliki.

Taruhan ini adalah pelajaran tentang efisiensi modal, membuktikan bahwa tim kecil yang terfokus dapat membangun seluruh jalur dan menstabilkan pelatihan tanpa cadangan yang melimpah.

Rekayasa Melalui Batasan Arsitektur yang Ekstrem

Trinity-Large-Thinking menarik perhatian karena sparsity ekstrem dari mekanisme perhatiannya. Meskipun model ini memiliki 400 miliar parameter, arsitektur Mixture-of-Experts-nya berarti hanya 1,56% atau 13 miliar parameter yang aktif untuk setiap token.

Ini memungkinkan model tersebut untuk memiliki pengetahuan mendalam tentang sistem besar sekaligus mempertahankan kecepatan inferensi dan efisiensi operasional dari model yang jauh lebih kecil, beroperasi sekitar 2 hingga 3 kali lebih cepat dibandingkan model sejenis pada perangkat keras yang sama. Pelatihan model yang begitu sparse menghadirkan tantangan stabilitas yang signifikan.

Untuk mencegah beberapa ahli menjadi “pemenang” sementara yang lain tetap “berat mati”, Arcee mengembangkan SMEBU, atau Soft-clamped Momentum Expert Bias Updates. Mekanisme ini memastikan bahwa para ahli terfokus dan terdistribusi secara merata di seluruh korpus web umum. Arsitektur ini juga menerapkan pendekatan hibrida, bergantian antara lapisan perhatian sliding window lokal dan global dalam rasio 3:1 untuk menjaga kinerja dalam skenario konteks panjang.

Kurikulum Data dan Penalaran Sintetik

Kerjasama Arcee dengan startup DatologyAI menyediakan kurikulum lebih dari 10 triliun token yang telah dikurasi. Namun, korpus pelatihan untuk model skala penuh diperluas menjadi 20 triliun token, dibagi rata antara data web yang telah dikurasi dan data sintetik berkualitas tinggi.

Berbeda dengan data sintetik berbasis imitasi biasa, di mana model yang lebih kecil hanya belajar meniru model yang lebih besar, DatologyAI memanfaatkan teknik untuk menulis kembali teks web mentah—seperti artikel Wikipedia atau blog—untuk merangkum informasi.

Proses ini membantu model belajar untuk mempertimbangkan konsep dan informasi daripada sekedar menghafal urutan token yang tepat. Untuk memastikan kepatuhan regulasi, upaya besar dilakukan untuk mengecualikan buku dan materi berhak cipta dengan lisensi yang tidak jelas, menarik pelanggan perusahaan yang khawatir tentang risiko kekayaan intelektual yang terkait dengan LLM mainstream.

Pendekatan berbasis data ini memungkinkan model untuk berkembang dengan baik sambil secara signifikan meningkatkan performa dalam tugas kompleks seperti matematika dan penggunaan alat multi-langkah.

Peralihan dari Chatbot yang Bising ke Agen Penalaran

Ciri khas dari rilis resmi ini adalah transisi dari model “instruksi” standar ke model “penalaran”.

Dengan menerapkan fase “berpikir” sebelum menghasilkan respons—mirip dengan loop internal yang ditemukan dalam Trinity-Mini sebelumnya—Arcee telah mengatasi kritik utama dari rilis “Preview” mereka di bulan Januari.

Pengguna awal model Preview mencatat bahwa model ini kadang-kadang kesulitan dengan instruksi multi-langkah dalam lingkungan yang kompleks dan bisa “kurang mengesankan” untuk tugas yang membutuhkan agen.

Pembaruan “Thinking” secara efektif menjembatani kesenjangan ini, memungkinkan apa yang Arcee sebut sebagai “agen cakrawala panjang” yang dapat mempertahankan koherensi di sepanjang serentetan panggilan alat tanpa menjadi “berantakan”.

Proses penalaran ini memungkinkan koherensi konteks yang lebih baik dan mengikuti instruksi yang lebih bersih dalam batasan. Ini memiliki dampak langsung pada Maestro Reasoning, sebuah turunan 32B parameter dari Trinity yang sudah digunakan dalam industri yang berfokus pada audit untuk menyediakan jejak “pikiran-ke-jawaban” yang transparan.

Tujuannya adalah untuk bergerak melampaui chatbot “berisik” atau tidak efisien menuju agen yang handal, murah, dan berkualitas tinggi yang tetap stabil dalam proses panjang.

Geopolitik dan Kasus untuk Bobot Terbuka Amerika

Signifikansi dari komitmen Arcee terhadap lisensi Apache 2.0 semakin diperkuat oleh mundurnya pesaing utama mereka dari batasan bobot terbuka.

Sepanjang tahun 2025, laboratorium riset Tiongkok seperti Qwen dan z.ai (alias Zhupai) menjadi pelopor arsitektur MoE yang efisien. Namun, seiring memasuki tahun 2026, laboratorium-laboratorium tersebut mulai beralih ke platform enterprise proprietary dan langganan khusus, menandakan pergeseran dari pertumbuhan komunitas yang murni.

Pecahnya tim-tim yang sebelumnya produktif ini, seperti mundurnya pemimpin teknis kunci dari laboratorium Qwen Alibaba, telah meninggalkan kekosongan di pasar bobot terbuka tingkat tinggi. Di Amerika Serikat, gerakan ini menghadapi krisisnya sendiri.

Divisi Llama Meta secara signifikan mundur dari lanskap frontier setelah penerimaan campur dari Llama 4 pada April 2025, yang mendapat laporan tentang masalah kualitas dan manipulasi tolok ukur.

Untuk para pengembang yang bergantung pada era dominasi Llama 3, kurangnya model terbuka 400B+ saat ini menciptakan kebutuhan mendesak akan alternatif yang ingin dipenuhi oleh Arcee.

Performa Benchmark dan Bagaimana Trinity-Large-Thinking Menyatukan Direktorat AI Sumber Terbuka AS Lainnya

Performa Trinity-Large-Thinking pada evaluasi spesifik agen menetapkannya sebagai pesaing frontier yang sah. Di PinchBench, yang menjadi metrik penting untuk mengevaluasi kemampuan model dalam tugas-tugas otonom, Trinity meraih skor 91.9, menempatkannya hanya sedikit di belakang pemimpin pasar proprietary, Claude Opus 4.6 (93.3).

Keberlanjutan ini tercermin di IFBench, di mana skor Trinity sebesar 52.3 hampir seimbang dengan skor Opus 4.6 yang mencapai 53.1. Hal ini menunjukkan bahwa pembaruan “Thinking” yang mengedepankan penalaran berhasil menangani hambatan mengikuti instruksi yang menjadi tantangan pada fase preview model sebelumnya.

Kemampuan teknis penalaran yang lebih luas menjadikannya berada di puncak pasar sumber terbuka saat ini. Ia mencatat 96.3 pada AIME25, menyamai Kimi-K2.5 yang berada di tingkat tinggi. Selain itu, Trinity juga melampaui pesaing besar lainnya seperti GLM-5 (93.3) dan MiniMax-M2.7 (80.0).

Sementara tolok ukur coding tinggi seperti SWE-bench Verified masih menunjukkan keunggulan untuk model-model tertutup kelas atas—dengan Trinity mengamankan skor 63.2 melawan 75.6 untuk Opus 4.6—delapan yang besar dalam biaya-per-token memposisikan Trinity sebagai lapisan infrastruktur berdaulat yang lebih efektif bagi perusahaan yang ingin menerapkan kemampuan ini pada skala produksi.

Mengenai tawaran model frontier sumber terbuka AS lainnya, gpt-oss dari OpenAI mencapai maksimal 120 miliar parameter, tetapi ada juga Google dengan Gemma (Gemma 4 baru saja dirilis minggu ini) dan keluarga Granite dari IBM yang juga layak disebut, meskipun dengan tolok ukur yang lebih rendah. Keluarga Nemotron dari Nvidia juga menarik, tetapi merupakan varian Qwen yang disesuaikan dan dilatih ulang.

|

Benchmark |

Arcee Trinity-Large |

gpt-oss-120B (Tinggi) |

IBM Granite 4.0 |

Google Gemma 4 |

|

GPQA-D |

76.3% |

80.1% |

74.8% |

84.3% |

|

Tau2-Airline |

88.0% |

65.8%* |

68.3% |

76.9% |

|

PinchBench |

91.9% |

69.0% (IFBench) |

89.1% |

93.3% |

|

AIME25 |

96.3% |

97.9% |

88.5% |

89.2% |

|

MMLU-Pro |

83.4% |

90.0% (MMLU) |

81.2% |

85.2% |

Jadi, bagaimana suatu perusahaan seharusnya memilih antara semua ini?

Arcee Trinity-Large-Thinking adalah pilihan utama bagi organisasi yang membangun agen otonom; arsitektur sparse 400B-nya unggul dalam “berpikir” melalui logika multi-langkah, matematika kompleks, dan penggunaan alat cakrawala panjang. Dengan mengaktifkan hanya sebagian kecil dari parameternya, ia menyediakan mesin penalaran berkecepatan tinggi bagi pengembang yang membutuhkan kemampuan perencanaan tingkat GPT-4o dalam kerangka kerja sumber terbuka yang efektif biaya.

Sebaliknya, gpt-oss-120B melayani sebagai titik tengah optimal untuk perusahaan yang memerlukan kinerja penalaran tinggi tetapi memprioritaskan biaya operasional yang lebih rendah dan fleksibilitas penerapan.

Karenanya, ia mengaktifkan hanya 5.1B parameter per forward pass, menjadikannya sangat cocok untuk beban kerja teknis seperti generasi kode kompetitif dan modeling matematika canggih yang perlu dijalankan pada perangkat keras terbatas, seperti satu H100 GPU.

Usaha penalaran yang dapat dikonfigurasi—menawarkan mode “Rendah,” “Sedang,” dan “Tinggi”—memungkinkan pengaturan yang terbaik untuk lingkungan produksi di mana latensi dan akurasi harus seimbang secara dinamis di berbagai tugas.

Untuk aplikasi dengan throughput tinggi yang lebih luas, Google Gemma 4 dan IBM Granite 4.0 berfungsi sebagai tulang punggung utama. Gemma 4 menawarkan “kepadatan kecerdasan” tertinggi untuk pengetahuan umum dan akurasi ilmiah, menjadikannya opsi paling serbaguna untuk R&D dan antarmuka chat berkecepatan tinggi.

Sementara itu, IBM Granite 4.0 dirancang untuk beban kerja perusahaan “sepanjang hari”, dengan memanfaatkan arsitektur hibrida yang menghilangkan kemacetan konteks untuk pemrosesan dokumen besar. Bagi bisnis yang khawatir dengan kepatuhan hukum dan efisiensi perangkat keras, Granite tetap menjadi fondasi paling dapat diandalkan untuk analisis RAG dan dokumen dalam skala besar.

Kepemilikan sebagai Fitur untuk Industri yang Diatur

Dalam iklim ini, pilihan Arcee untuk lisensi Apache 2.0 adalah tindakan diferensiasi yang disengaja. Berbeda dengan lisensi komunitas yang ketat digunakan oleh beberapa pesaing, Apache 2.0 memungkinkan perusahaan benar-benar memiliki tumpukan kecerdasan mereka sendiri tanpa bias “kotak hitam” dari model chat tujuan umum.

“Pengembang dan perusahaan membutuhkan model yang dapat mereka periksa, latih ulang, host, distilasi, dan miliki,” ujar Lucas Atkins dalam pengumuman peluncuran.

Kepemilikan ini penting untuk “pelajaran pahit” melatih model-model kecil: biasanya Anda perlu melatih model frontier yang besar terlebih dahulu untuk menghasilkan data sintetik berkualitas tinggi dan logits yang diperlukan untuk membangun model-model mahasiswa yang efisien.

Lebih jauh lagi, Arcee telah merilis Trinity-Large-TrueBase, sebuah checkpoint 10 triliun token mentah. TrueBase memberi tampilan “tidak terkontaminasi” yang langka pada kecerdasan dasar sebelum penyetelan instruksi dan pembelajaran penguatan diterapkan. Bagi peneliti di industri yang sangat teratur seperti keuangan dan pertahanan, TrueBase memungkinkan audit yang autentik dan penyesuaian kustom dimulai dari awal yang bersih.

Verdict Komunitas dan Masa Depan Distilasi

Tanggapan dari komunitas pengembang sebagian besar positif, mencerminkan keinginan untuk lebih banyak bobot terbuka dan model yang dibuat di AS.

Di X, para peneliti menyoroti disruptifnya, mencatat bahwa harga “sangat murah” untuk model sebesar ini akan menjadi keberuntungan bagi komunitas agen.

Di situs inferensi model AI sumber terbuka OpenRouter, Trinity-Large-Preview menempatkan diri sebagai model terbuka paling banyak digunakan di AS, melayani lebih dari 80,6 miliar token pada hari-hari puncak seperti 1 Maret 2026.

Kedekatan Trinity-Large-Thinking dengan Claude Opus 4.6 pada PinchBench—di angka 91.9 versus 93.3—sangat mencolok jika dibandingkan dengan biayanya. Di harga $0.90 per satu juta token output, Trinity sekitar 96% lebih murah dibandingkan Opus 4.6, yang dibanderol $25 per satu juta token output.

Strategi Arcee kini fokus pada pengembalian pelajaran pelatihan dan pascapelatihan ini ke bawah stack. Sebagian besar kerja keras yang dicurahkan ke Trinity Large kini akan mengalir ke model-model Mini dan Nano, menyegarkan lini compact perusahaan dengan distilasi penalaran tingkatan frontiers.

Ketika laboratorium global beralih menuju penguncian proprietary, Arcee telah memposisikan Trinity sebagai lapisan infrastruktur yang bisa dan harus dikontrol oleh pengembang, serta dapat disesuaikan untuk alur kerja agentic jangka panjang.