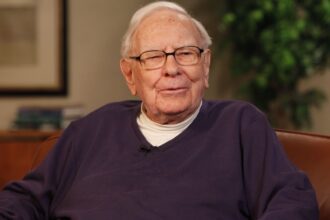

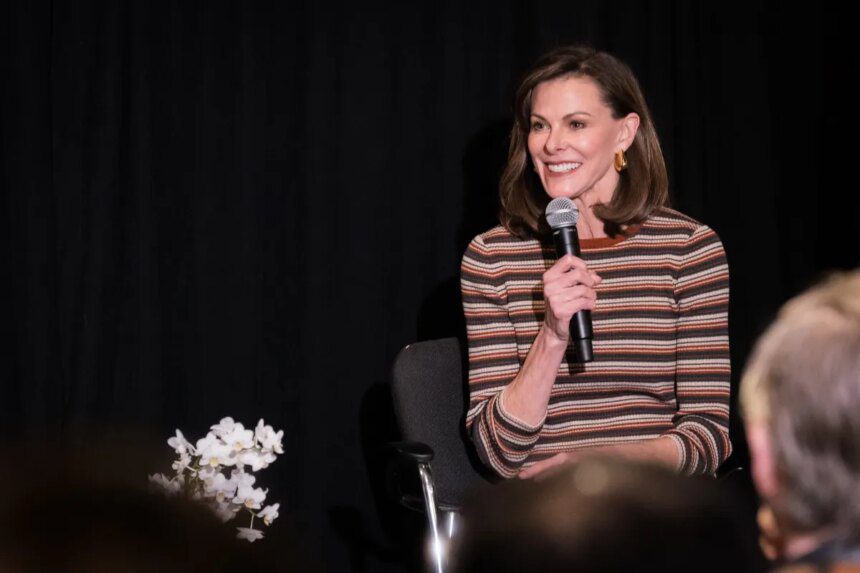

Campbell Brown menghabiskan kariernya untuk mengejar informasi yang akurat. Dia dulu seorang jurnalis TV terkemuka, dan sekarang menjabat sebagai kepala berita di Facebook yang pertama dan satu-satunya. Kini, di tengah gelombang perubahan yang dibawa oleh AI terhadap cara orang mengonsumsi informasi, dia merasa sejarah sepertinya akan terulang. Kali ini, dia tidak ingin menunggu orang lain untuk memperbaikinya.

Perusahaan yang didirikannya, Forum AI, baru-baru ini dibahas bersamanya oleh Tim Fernholz dari TechCrunch dalam sebuah acara StrictlyVC di San Francisco. Forum AI mengevaluasi kinerja model-model dasar dalam topik-topik “berisiko tinggi” seperti geopolitik, kesehatan mental, keuangan, dan perekrutan. Ini adalah subjek yang sering kali tidak memiliki jawaban tegas ya atau tidak, dan sangat kompleks serta mengaburkan garis antara fakta dan opini.

Visinya adalah menemukan para ahli terkemuka di dunia, menyusun standar pengukuran, dan kemudian melatih “wasit AI” untuk mengevaluasi model-model ini secara luas. Untuk proyek geopolitik Forum AI, Campbell telah merekrut nama-nama besar seperti Niall Ferguson, Fareed Zakaria, mantan Menteri Luar Negeri Tony Blinken, mantan Ketua DPR Kevin McCarthy, dan Anne Neuberger yang memimpin cybersecurity di pemerintahan Obama. Tujuannya adalah agar wasit AI mencapai konsensus sekitar 90 persen dengan para ahli manusia, ambang batas yang menurutnya sudah bisa dicapai oleh Forum AI.

Campbell merunut kembali asal mula Forum AI, yang didirikan 17 bulan lalu di New York, kepada suatu momen spesifik. “Saya berada di Meta saat ChatGPT pertama kali dirilis untuk umum,” kenangnya. “Dan saya ingat segera setelah itu menyadari bahwa ini akan menjadi saluran utama informasi. Dan itu tidak terlalu bagus.” Implikasi untuk anak-anaknya membuat momen itu terasa hampir eksistensial. “Anak-anak saya akan jadi bodoh jika kita tidak memikirkan cara untuk memperbaikinya,” pikirnya.

Yang paling membuatnya frustrasi adalah bahwa akurasi tampaknya bukan prioritas siapa pun. Menurutnya, perusahaan-perusahaan model dasar “sangat fokus pada pengkodean dan matematika,” sementara berita dan informasi jauh lebih rumit. Namun dia berpendapat, semakin sulit bukan berarti dapat diabaikan.

Ketika Forum AI mulai mengevaluasi model-model terkemuka, hasilnya tidak menggembirakan. Dia menyebut Gemini yang menarik informasi dari situs web Partai Komunis Tiongkok “untuk cerita yang tidak ada hubungannya dengan Tiongkok,” dan mencatat adanya bias politik yang condong ke kiri di hampir semua model. Kegagalan yang lebih halus juga banyak terjadi, seperti kurangnya konteks dan perspektif, serta argumen yang dipelintir tanpa pengakuan. “Masih ada jalan panjang,” ujarnya. “Tapi saya juga percaya ada beberapa perbaikan yang sangat mudah yang bisa meningkatkan hasilnya secara drastis.”

Campbell menghabiskan bertahun-tahun di Facebook mengamati apa yang terjadi ketika sebuah platform mengoptimalkan hal-hal yang salah. “Kami banyak gagal dalam berbagai hal yang kami coba,” katanya kepada Fernholz. Program pemeriksaan fakta yang dia bangun sudah tidak ada lagi. Pelajaran yang diambil meski media sosial tutup mata terhadapnya adalah bahwa mengedepankan keterlibatan hanya merugikan masyarakat dan membuat banyak orang kurang terinformasi.

Harapannya adalah bahwa AI dapat memutus siklus tersebut. “Saat ini, jalannya bisa ke mana saja,” ujarnya; perusahaan bisa memberikan apa yang diinginkan pengguna, atau mereka bisa “memberikan apa yang nyata dan jujur.” Dia mengakui bahwa versi idealis dari itu—AI yang mengutamakan kebenaran—mungkin terdengar naif. Namun dia percaya bahwa sektor bisnis bisa jadi sekutu yang tidak terduga di sini. Perusahaan yang menggunakan AI untuk keputusan kredit, pinjaman, asuransi, dan perekrutan tentu memperhatikan pertanggungjawaban, dan “mereka akan ingin Anda fokus pada akurasi.”

Tuntutan dari sektor bisnis ini juga menjadi taruhan Forum AI untuk kelangsungan usaha mereka, meski mengubah minat akan kepatuhan menjadi pendapatan yang konsisten masih jadi tantangan, terutama karena banyak pasar saat ini masih puas dengan audit yang sekadar memenuhi standar dan tidak lebih.

Menurutnya, lanskap kepatuhan itu “sungguh konyol.” Ketika Kota New York mengesahkan hukum bias perekrutan yang pertama kali yang mewajibkan audit AI, pengawas negara bagian menemukan bahwa lebih dari setengahnya memiliki pelanggaran yang tidak terdeteksi. Evaluasi yang nyata, katanya, membutuhkan keahlian domain untuk menghadapi bukan hanya skenario yang sudah diketahui, tetapi juga kasus-kasus ekstrem yang “bisa menimbulkan masalah yang tidak terpikirkan orang.” Dan pekerjaan itu memakan waktu. “Orang umum yang cerdas tidak akan cukup.”

Campbell—yang perusahaannya musim gugur lalu mengumpulkan dana sebesar $3 juta yang dipimpin oleh Lerer Hippeau—berada di posisi yang unik untuk mendeskripsikan ketidakselarasan antara citra industri AI dan realitas bagi sebagian besar pengguna. “Anda mendengar pemimpin perusahaan teknologi besar berkata, ‘Teknologi ini akan mengubah dunia,’ ‘akan menganggurkan Anda,’ ‘akan menyembuhkan kanker,'” katanya. “Tapi bagi orang biasa yang hanya menggunakan chatbot untuk bertanya hal-hal dasar, mereka masih menerima banyak jawaban yang salah.”

Kepercayaan terhadap AI saat ini berada pada tingkat yang sangat rendah, dan dia berpikir ketidakpercayaan tersebut, dalam banyak hal, adalah hal yang wajar. “Percakapan sepertinya sedang berlangsung di Silicon Valley tentang satu hal, sementara perbincangan yang sama sekali berbeda terjadi di kalangan konsumen.”